Појединачни уноси података се чувају у облику „ Тензори ” у ПиТорцх-у и “ градијенти ” тензора се израчунавају коришћењем пропагације уназад у оквиру петље за обуку модела дубоког учења. Термин ' унсцалед ” значи да су подаци сирови и да није укључена претходна обрада или оптимизација. Нескалирани градијент тензора пружа праву вредност промене у вези са наведеном функцијом губитка.

У овом блогу ћемо разговарати о томе како израчунати нескалирани градијент тензора у ПиТорцх-у.

Шта је нескалирани градијент тензора у ПиТорцх-у?

Тензори су вишедимензионални низови који садрже податке и могу да раде на ГПУ-овима у ПиТорцх-у. Тензори који садрже необрађене податке из скупа података без претходне обраде, трансформације или оптимизације називају се тензори без скалирања. Међутим, „ Градијент без величине ” се разликује од нескалираног тензора и мора се водити рачуна да се то двоје не помеша. Нескалирани градијент тензора се израчунава у односу на изабрану функцију губитка и нема даље оптимизације или скалирања.

Како израчунати нескалирани градијент тензора у ПиТорцх-у?

Нескалирани градијент тензора је стварна вредност стопе промене улазних података у вези са изабраном функцијом губитка. Необрађени подаци о градијенту су важни за разумевање понашања модела и његовог напредовања током циклуса обуке.

Следите доле наведене кораке да бисте научили како да израчунате нескалирани градијент тензора у ПиТорцх-у:

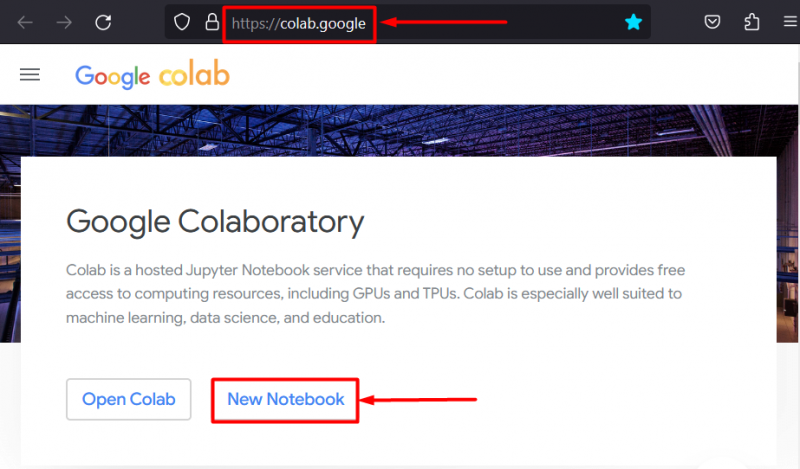

Корак 1: Започните пројекат постављањем ИДЕ-а

Гоогле Цолаборатори ИДЕ је један од најбољих избора за развој ПиТорцх пројеката јер пружа бесплатан приступ ГПУ-има за бржу обраду. Иди у Цолаб веб сајт и кликните на „ Нова бележница ” опција за почетак рада:

Корак 2: Увезите библиотеку Ессентиал Торцх

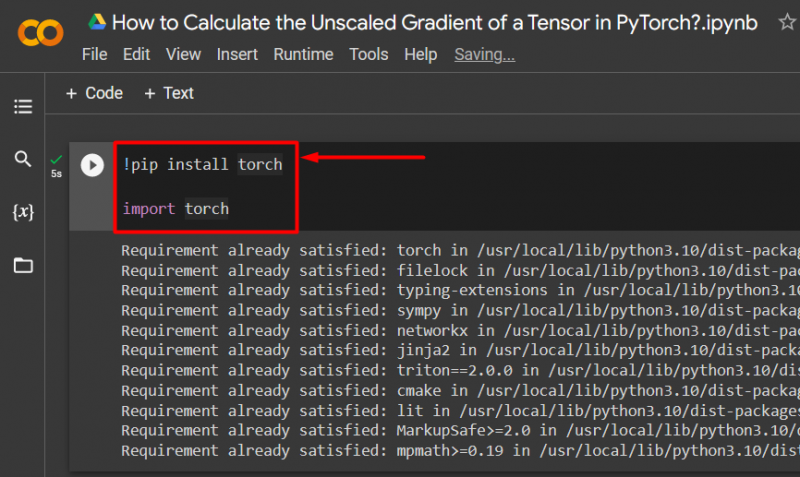

Сва функционалност ПиТорцх оквира је садржана у оквиру „ Бакља ” библиотека. Сваки ПиТорцх пројекат почиње инсталирањем и увозом ове библиотеке:

!пип инсталл торцхувозна бакља

Горњи код ради на следећи начин:

- “! пип ” је инсталациони пакет за Питхон који се користи за инсталирање библиотека у пројектима.

- „ увоз ” команда се користи за позивање инсталираних библиотека у пројекат.

- Овом пројекту је потребна само функционалност „ бакља ” библиотека:

Корак 3: Дефинишите ПиТорцх тензор са градијентом

Користити ' бакља.тензор ()” метода за дефинисање тензора са градијентом “ рекуирес_град=Тачно ” метод:

А = торцх.тенсор([5.0], рекуирес_град=Труе)Корак 4: Дефинишите једноставну функцију губитка

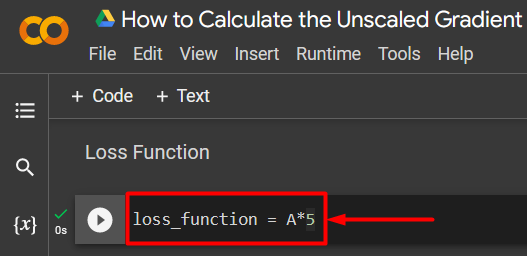

Функција губитка је дефинисана коришћењем једноставне аритметичке једначине као што је приказано:

функција_губљења = А*5

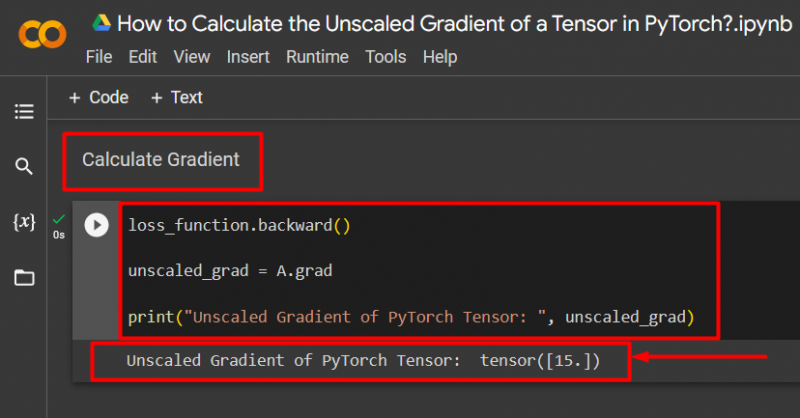

Корак 5: Израчунајте градијент и одштампајте за излаз

Користити ' уназад ()” метод за израчунавање нескалираног градијента као што је приказано:

лосс_фунцтион.бацквард()унсцалед_град = А.град

принт('Унсцалед Градијент ПиТорцх тензора: ', унсцалед_град)

Горњи код ради на следећи начин:

- Користити ' уназад ()” метод за израчунавање нескаларираног градијента путем пропагације уназад.

- Додели „ А.град ' до ' унсцалед_град ' променљива.

- На крају, користите „ принт ()” метода за приказивање излаза нескалираног градијента:

Белешка : Можете приступити нашој Цолаб бележници на овом месту линк .

Про врх

Нескалирани градијент тензора може показати тачан однос улазних података са функцијом губитка за неуронску мрежу унутар ПиТорцх оквира. Необрађени неуређени градијент показује како су обе вредности систематски повезане.

Успех! Управо смо показали како израчунати нескалирани градијент тензора у ПиТорцх-у.

Закључак

Израчунајте нескалирани градијент тензора у ПиТорцх-у тако што ћете прво дефинисати тензор, а затим користити методу уназад() да бисте пронашли градијент. Ово показује како модел дубоког учења повезује улазне податке са дефинисаном функцијом губитка. У овом блогу смо дали постепени водич о томе како израчунати нескалирани градијент тензора у ПиТорцх-у.